-

- Downloads

Mise dans archive

Showing

- README.md 0 additions, 93 deletionsREADME.md

- Readme.md 0 additions, 81 deletionsReadme.md

- deuxieme_etude.png 0 additions, 0 deletionsdeuxieme_etude.png

- mphf.png 0 additions, 0 deletionsmphf.png

- nombre_reallocations.png 0 additions, 0 deletionsnombre_reallocations.png

- slides_hash.pdf 0 additions, 0 deletionsslides_hash.pdf

- taille_memoire.png 0 additions, 0 deletionstaille_memoire.png

- temps_d_insertion.png 0 additions, 0 deletionstemps_d_insertion.png

- tp2_miso.zip 0 additions, 0 deletionstp2_miso.zip

- tp_2_miso_dict.py 0 additions, 119 deletionstp_2_miso_dict.py

- tp_2_miso_mphf.py 0 additions, 210 deletionstp_2_miso_mphf.py

README.md

deleted

100644 → 0

Readme.md

deleted

100644 → 0

deuxieme_etude.png

deleted

100644 → 0

18 KiB

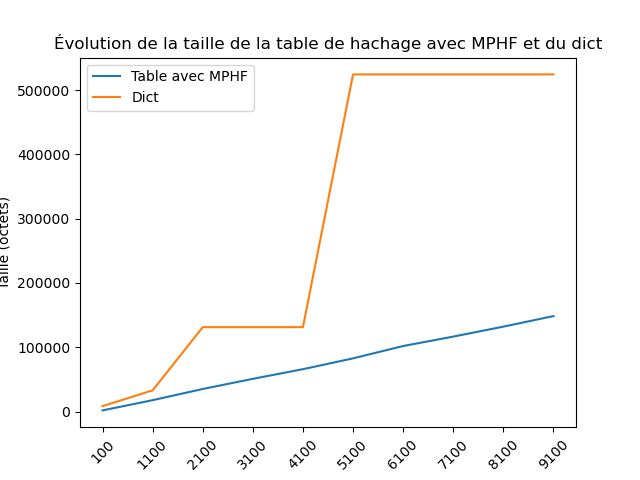

mphf.png

deleted

100644 → 0

33.5 KiB

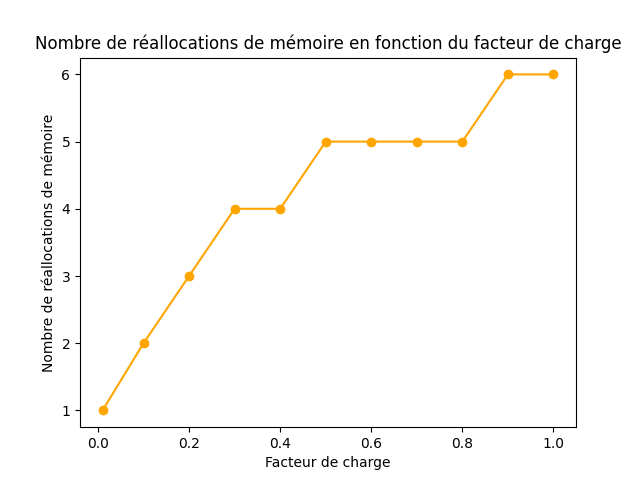

nombre_reallocations.png

deleted

100644 → 0

24.9 KiB

slides_hash.pdf

deleted

100644 → 0

File deleted

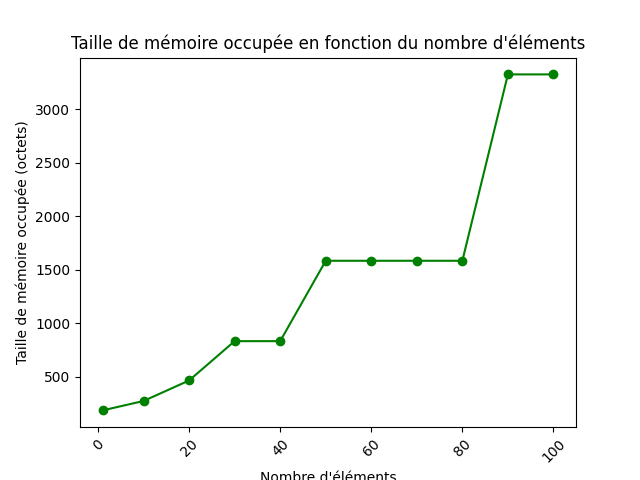

taille_memoire.png

deleted

100644 → 0

27.6 KiB

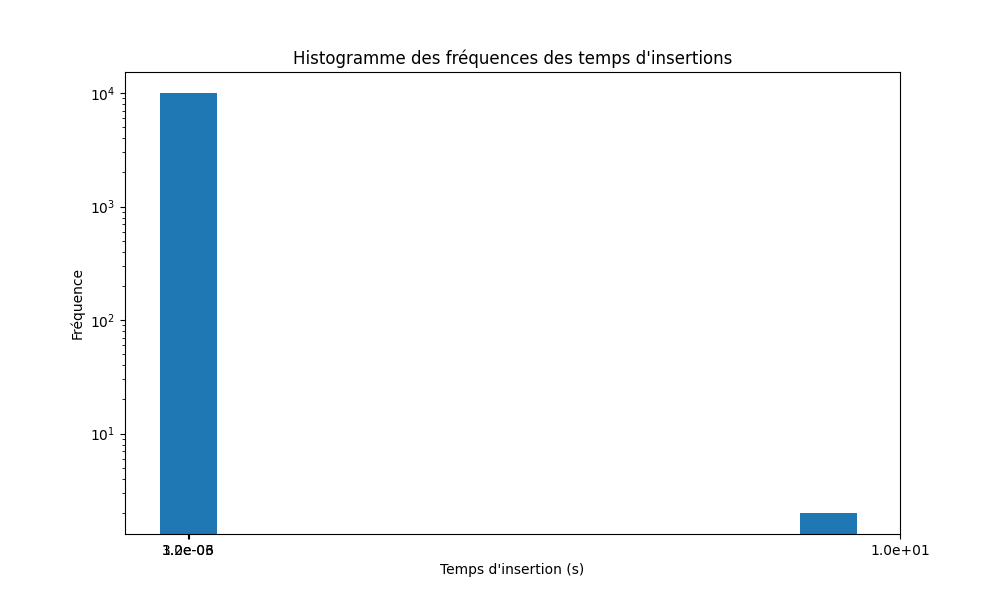

temps_d_insertion.png

deleted

100644 → 0

25 KiB

tp2_miso.zip

0 → 100644

File added

tp_2_miso_dict.py

deleted

100644 → 0

tp_2_miso_mphf.py

deleted

100644 → 0